从输出反推输入、从行为反推意图——AI助手的“倒放”能力正在成为技术圈的热门话题。

一、开篇引入

本文将从

二、痛点切入:为什么需要理解AI助手的“倒放”逻辑

在传统的开发模式中,我们通常的工作流程是:提出需求 → 编写代码 → 得到输出。这种方式在常规业务中运行良好,但在与AI交互时,问题逐渐暴露。

先来看一个传统实现的示例:

传统方式:直接让AI完成任务,但不理解其决策过程 def traditional_ai_task(user_input): 黑盒调用,无法追踪推理过程 response = call_llm_api(user_input) return response 问题:输出不理想时,我们不知道哪里出了问题 result = traditional_ai_task("帮我写一个处理列表的函数") AI随意假设“处理”是乘以2,但用户可能只是想要过滤

这个传统方式存在几个明显的痛点:

黑盒效应:AI的推理过程不可见,输出不符合预期时难以定位问题源头

耦合度高:提示词与业务逻辑混在一起,难以复用和维护

扩展性差:增加新功能时,往往需要重新设计整个提示流程

调试困难:出现问题只能靠反复尝试不同的提示词,效率极低

正是在这样的背景下, “AI助手倒放”思维应运而生——与其盲目地让AI猜测需求,不如从结果倒推意图、从输出反推输入,让AI的行为变得透明、可控、可追溯。

三、核心概念讲解:反向生成需求(Reverse Requirement Generation)

标准定义

反向生成需求(Reverse Requirement Generation) ,是指将代码片段或输出结果输入AI,让AI反向推导这段代码背后的用户需求或意图-20。简单说,就是让AI从“结果”倒推“目的”。

关键词拆解

| 关键词 | 内涵解释 |

|---|---|

| 反向 | 与常规“需求→代码”方向相反,是“代码→需求” |

| 生成 | AI主动产出结构化分析,而非被动响应 |

| 需求 | 代码背后的用户意图、业务场景、设计考量 |

生活化类比

想象一个场景:你收到一份陌生的拼装好的乐高模型,但不知道它原本的设计图是什么。传统方法是拆掉重拼来猜,而“反向生成需求”就像让一个乐高大师只看成品就能告诉你:“这个模型的设计意图是搭建一个城堡,塔楼用于瞭望,城墙用于防御,入口需要可开合结构。”——AI在这里扮演的就是那个“乐高大师”的角色。

作用与价值

这种方法能让AI从结果倒推目的,避免直接生成代码时偏离预期-20。它尤其适用于三个核心场景:

理解遗留代码:面对没有注释的老代码,AI能快速还原其设计意图

验证团队沟通:对比AI反向推导的需求与实际预期,发现理解偏差

自动生成文档:为现有代码自动补全需求说明,提升文档质量-20

四、关联概念讲解:Prompt逆向工程(Prompt Reverse Engineering)

标准定义

Prompt逆向工程(Prompt Reverse Engineering,简称Prompt RE) ,是指通过分析AI的输出内容,反向推导出生成该输出所使用的提示词(Prompt)的方法-21。

它与反向生成需求的关系

这两个概念容易混淆,它们的逻辑关系是:

| 维度 | 反向生成需求 | Prompt逆向工程 |

|---|---|---|

| 目标 | 推导代码/输出的业务意图 | 推导生成输出的提示词结构 |

| 输入 | 代码片段或输出内容 | AI的生成结果 |

| 输出 | 用户需求描述(做什么) | 可复用的Prompt模板(怎么做) |

| 层次 | 业务语义层 | 技术指令层 |

一句话总结:反向生成需求回答“为什么这样做”,Prompt逆向工程回答“用什么指令做到的” 。

运行机制示例

假设你有一段AI生成的内容,想知道它是通过什么提示词产生的:

输入:一段AI生成的文字 sample_output = """ 在一个宁静的月夜庭院中,一位老者坐在竹椅上,手持茶壶, 月光如水洒在青石板上,远处传来几声虫鸣。 """ 执行Prompt逆向工程 prompt_reverse = """ 请对该段文字进行提示词逆向工程分析,按以下结构反推提示词: 【主体】:____; 【场景】:____; 【风格关键词】:____; 【特殊要求】:____。 """ AI输出反推结果 【主体】:老者 【场景】:月夜庭院、竹椅、茶壶、青石板 【风格关键词】:宁静、诗意、慢节奏、视觉化描写 【特殊要求】:包含听觉元素(虫鸣),画面需有光线变化(月光洒落)

这个过程需要提供具象的输出样本,并引导AI识别其中的结构要素与隐含指令-22。

五、概念关系与区别总结

核心逻辑关系图

┌─────────────────────────────────────────────────┐ │ AI助手行为分析 │ ├──────────────────────┬──────────────────────────┤ │ 反向生成需求 │ Prompt逆向工程 │ │ (业务意图层) │ (指令结构层) │ ├──────────────────────┼──────────────────────────┤ │ 代码 → 用户需求 │ AI输出 → Prompt模板 │ │ "为什么这样做" │ "怎么做到的" │ └──────────────────────┴──────────────────────────┘ │ ▼ AI Agent架构(底层支撑)

一句话记忆

反向生成需求是“看懂结果”,Prompt逆向工程是“学会指令”,两者共同构成理解AI行为的完整闭环。

六、代码示例演示:反向分析AI助手行为

下面通过一个完整的Python示例,展示如何用代码实现AI助手的“倒放”分析。这个示例模拟了从一段AI生成的代码反向推导其原始需求的完整流程。

import json from typing import Dict, Any class AIReverseEngineer: """ AI助手逆向分析器 核心功能:从输出结果反向推导输入需求与意图 """ def __init__(self, llm_client=None): self.client = llm_client 实际的LLM API客户端 def reverse_generate_requirement(self, code_snippet: str) -> Dict[str, Any]: """ 反向生成需求:从代码推导用户意图 这是"AI助手倒放"的核心方法 """ reverse_prompt = f""" 你是一个需求分析专家。请从以下代码片段反向生成用户需求: 代码:

{code_snippet}

请按以下格式输出: 1. 函数/方法的预期目的 2. 输入参数的含义与类型要求 3. 输出结果的格式与含义 4. 潜在的边界条件假设 """ 调用AI进行反向分析 analysis = self._call_llm(reverse_prompt) return {"requirement_analysis": analysis} def trace_decision_path(self, user_query: str, ai_response: str) -> list: """ 决策路径追溯:倒推出AI从输入到输出的每一步推理 适用于理解复杂Agent的决策逻辑 """ trace_prompt = f""" 用户输入: {user_query} AI输出: {ai_response} 请倒推分析AI的完整思考过程,按时间倒序列出: - 最后一步:基于什么结论生成了最终输出? - 上一步:基于什么中间结果得出该结论? - ... 直到第一步:最初的意图识别是什么? """ return self._call_llm(trace_prompt) def compare_with_traditional(self, task_description: str): """ 对比传统方式与反向分析方式的差异 """ 传统方式:直接执行 traditional_result = self._call_llm( f"请完成以下任务:{task_description}" ) 反向分析方式:先要求AI解释意图 reverse_analysis = self._call_llm( f"请先解释你会如何理解这个任务'{task_description}',再执行它" ) return { "traditional": traditional_result, "reverse_enhanced": reverse_analysis } ========== 实际使用示例 ========== def demo_reverse_engineering(): """演示反向工程的实际应用""" engineer = AIReverseEngineer() 示例1:从一段复杂的处理代码反向生成需求 unknown_code = """ def mystery_function(data): result = [] for item in data: if item.get('score', 0) > 85: processed = { 'name': item['name'], 'grade': 'A', 'recommend': True } result.append(processed) return sorted(result, key=lambda x: x['name']) """ print("【反向生成需求】从代码推导用户意图:") analysis = engineer.reverse_generate_requirement(unknown_code) print(json.dumps(analysis, ensure_ascii=False, indent=2)) 预期输出: 1. 目的:筛选出成绩>85分的优秀学生,标记为'A'等级并推荐 2. 输入:包含'name'和'score'字段的学生列表 3. 输出:按姓名排序的推荐学生列表 4. 边界假设:每个元素都包含'name'字段,score缺失时默认为0 if __name__ == "__main__": demo_reverse_engineering()

关键步骤说明:

第4-12行:定义

AIReverseEngineer类,封装反向分析的核心逻辑第14-27行:

reverse_generate_requirement方法实现从代码到需求的逆向推导第29-41行:

trace_decision_path方法倒推AI的完整决策路径第43-56行:对比传统方式与反向增强方式的差异

对比传统“盲目调优”的方式,反向分析让开发者能清晰地看到AI的理解路径,从而精准定位问题所在,而非靠猜测反复尝试。

七、底层原理与技术支撑

1. LLM的推理能力——倒放分析的根本基础

AI助手能够完成“倒放”分析,最底层依赖的是大语言模型(Large Language Model,LLM)的推理能力。LLM通过学习海量文本数据,掌握了人类语言的规律和逻辑关系-58。当我们将一段代码或输出输入给LLM时,它能:

识别代码中的控制流模式(循环、条件分支)

提取数据流特征(变量累加、索引变化)

匹配常见计算范式(扫描、归约、映射)

推导出高层语义意图-24

这种“从行为反推意图”的能力,本质上依赖于LLM对编程语言和自然语言之间映射关系的深层理解。

2. Agent架构——支撑“倒放”的系统框架

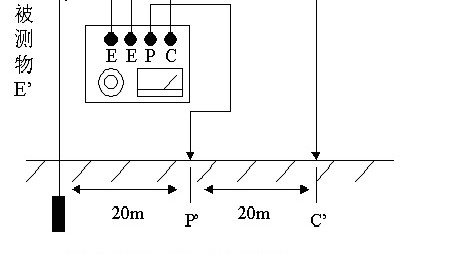

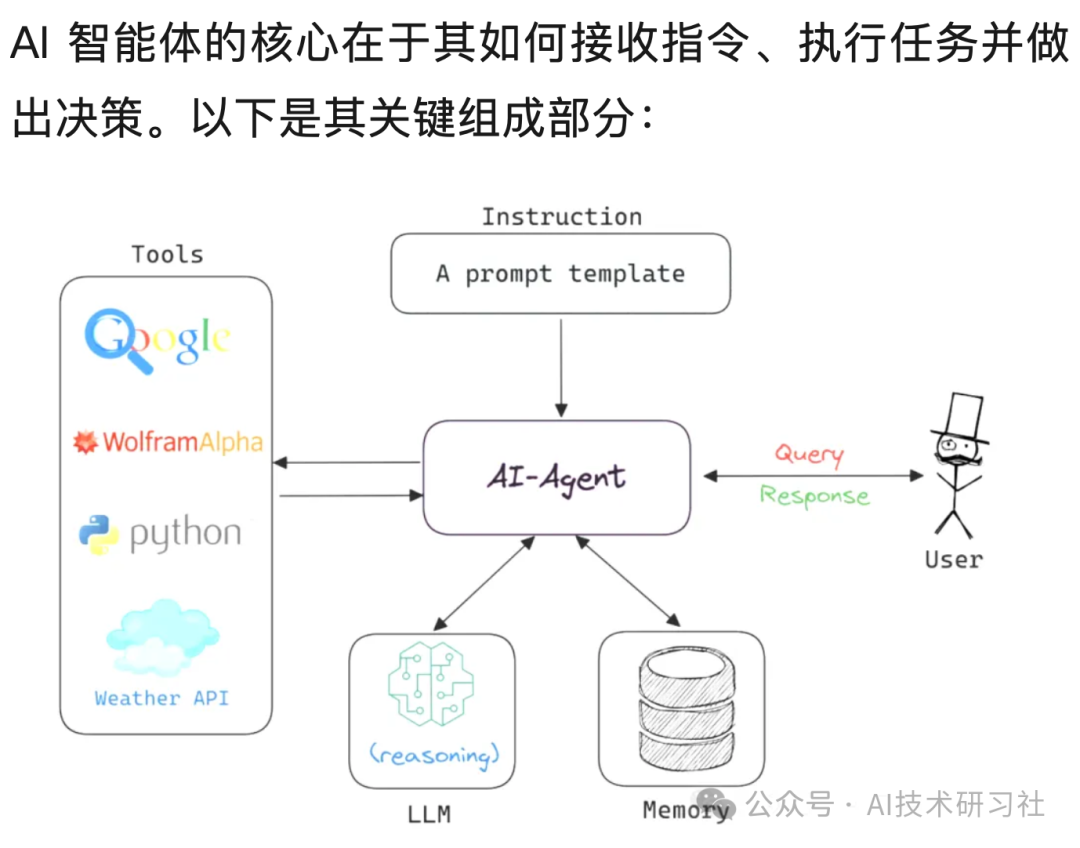

AI助手倒放分析不仅仅是单个LLM的任务,更离不开完整的Agent架构支撑。一个标准的AI Agent架构包含五大核心模块-62:

| 模块 | 在倒放分析中的作用 |

|---|---|

| 感知与意图理解层 | 解析代码/输出,识别关键特征 |

| 记忆模块 | 存储历史分析模式,提升推理一致性 |

| 推理与决策层 | 执行核心的逆向推理逻辑 |

| 执行与工具调用层 | 调用代码解释器、等工具辅助分析 |

| 反馈与优化层 | 验证推导结果,迭代优化分析质量 |

值得注意的是,当前的Agent架构已经从早期的“Prompt驱动”演进为 “Context核心”的自主决策架构,即由历史交互、环境感知和任务状态构成的动态信息中枢来驱动决策-38。这一演进为AI助手的倒放分析提供了更强大的上下文理解能力。

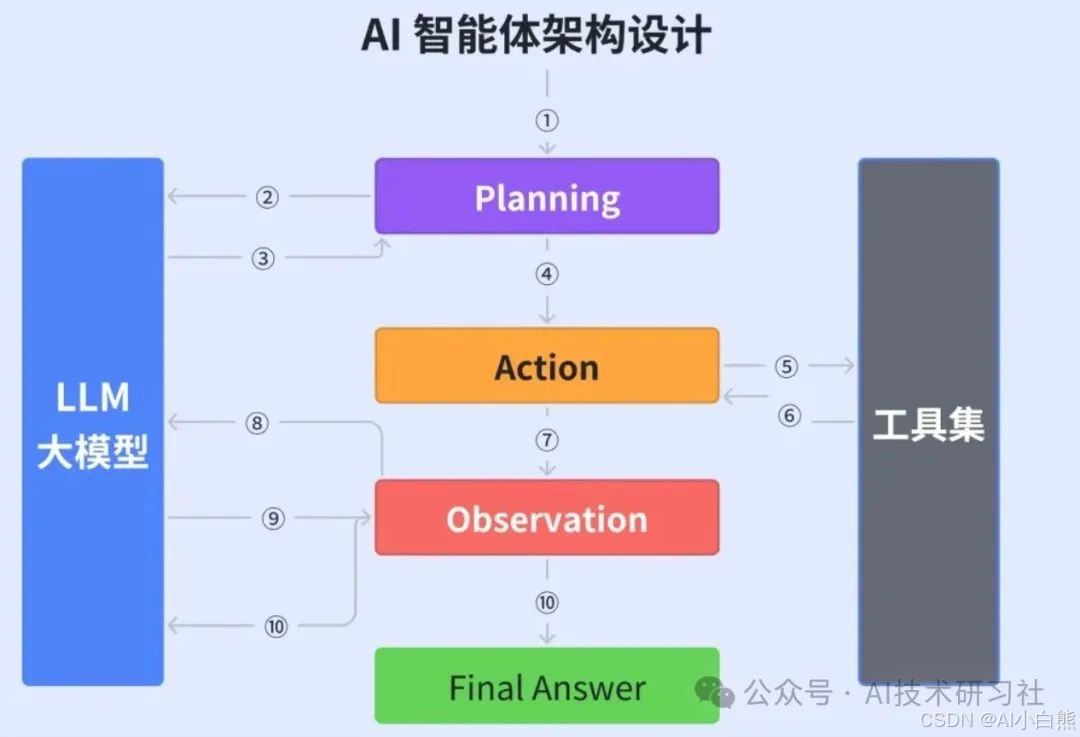

3. ReAct框架——思考与行动的统一

在AI助手的倒放分析流程中,ReAct框架(Reasoning + Acting,推理与行动协同框架) 扮演着关键角色。ReAct的核心是“先思考,再行动,再观察”的循环-34。具体到倒放场景:

Thought(思考) :AI识别出需要分析的代码片段

Action(行动) :调用代码分析工具提取特征

Observation(观察) :获取分析结果并更新理解

循环:基于观察继续深入推理,直至得出完整结论

这种循环使得AI能够像经验丰富的工程师一样,一边“读”代码一边问自己:“这段逻辑到底想干什么?”

八、高频面试题与参考答案

面试题1:什么是AI Agent?它与传统LLM有什么区别?

参考答案(建议记忆要点)

AI Agent(AI智能体) 是一种能够自主感知环境、理解用户意图、进行逻辑推理与任务规划、调用工具完成目标,并具备自我迭代能力的AI系统-62。

与传统LLM的核心区别:

| 维度 | 传统LLM | AI Agent |

|---|---|---|

| 工作模式 | 问答式,单次响应 | 自主式,多步闭环 |

| 任务边界 | 单轮对话 | 复杂任务拆解与执行 |

| 工具使用 | 无 | 可调用API、代码、等 |

| 记忆能力 | 有限上下文 | 短期+长期记忆 |

| 反馈迭代 | 无 | 根据结果自我修正-62 |

💡 踩分点提示: 回答时突出“自主性”“规划能力”“工具调用”三个核心特征。

面试题2:AI Agent的经典架构包含哪些核心模块?

参考答案

工业界通用的AI Agent架构包含五大核心模块:

感知与意图理解层:解析用户需求,明确任务目标

记忆模块:分为短期上下文记忆和长期知识库/经验库

推理与决策层:基于LLM进行逻辑判断、任务拆解、步骤规划

执行与工具调用层:调用代码、、API等能力完成实际操作

反馈与优化层:判断执行结果是否达标,失败则自动重试、修正逻辑-62

💡 踩分点提示: 按“感知→记忆→推理→执行→反馈”的顺序回答,展现系统化思维。

面试题3:什么是Prompt逆向工程?如何实现?

参考答案

Prompt逆向工程(Prompt Reverse Engineering) 是指通过分析AI的输出内容,反向推导出生成该输出所使用的提示词(Prompt)的方法-21。

实现步骤:

提供高质量的输出样本

限定反推维度(如主体、场景、风格、特殊要求)

引导AI识别结构要素与隐含指令

用结构化模板输出反推结果

通过分步剥离验证提示词的有效性-22

面试题4:如何设计一个能“反向分析”自身决策的AI助手?

参考答案(进阶题)

设计思路的核心是构建 “可追溯的决策闭环” :

决策日志记录:Agent的每一步推理(Thought)、行动(Action)、观察(Observation)都需要结构化记录

反向追溯接口:提供API或方法,允许用户输入最终输出,反查完整的决策路径

因果推理模块:基于历史决策日志,建立“输入特征→中间状态→最终输出”的因果链

自我验证机制:Agent能够用反向推导的结果与自己原有的理解进行对比验证

代码示例思路:

class TraceableAgent: def __init__(self): self.decision_log = [] 记录决策历史 def execute_with_trace(self, task): 记录每一步决策 step_1 = self.think(task) 记录推理 step_2 = self.act(step_1) 记录行动 step_3 = self.observe(step_2) 记录观察 self.decision_log.append([step_1, step_2, step_3]) return step_3 def reverse_trace(self, output): 从最终输出反向遍历决策日志 return self._backward_chain(output)

九、总结

核心知识点回顾

| 序号 | 知识点 | 核心要点 |

|---|---|---|

| 1 | 反向生成需求 | 代码 → 用户意图,回答“为什么这样做” |

| 2 | Prompt逆向工程 | AI输出 → 提示词结构,回答“怎么做到的” |

| 3 | AI Agent架构 | 五大模块:感知→记忆→推理→执行→反馈 |

| 4 | ReAct框架 | 思考(Thought)→ 行动(Action)→ 观察(Observation)循环 |

重点与易错点提醒

⚠️ 不要混淆“反向生成需求”与“Prompt逆向工程”——前者关注业务语义,后者关注指令结构

⚠️ 避免过度依赖“倒放”分析——它是理解和调试工具,不能替代正向设计

⚠️ 注意上下文完整性——倒放分析的质量高度依赖于输入样本的丰富度和结构化程度

进阶方向预告

下一篇我们将深入探讨 AI Agent的工程化落地——从LangChain、LangGraph到MCP协议,如何构建工业级的智能体系统,敬请期待。