北京时间2026年4月8日

开篇引入

如果你还在写map.setCenter()、searchPOI()、calculateRoute()这种代码——抱歉,你已经过时了。

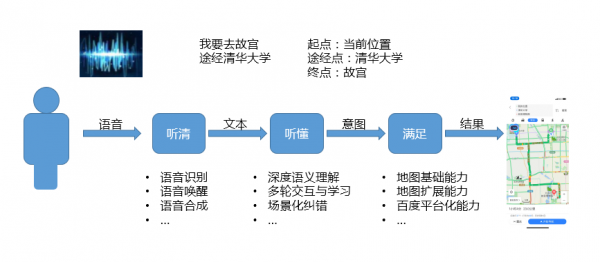

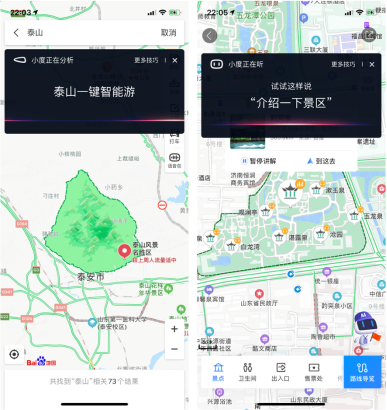

2026年的AI地图技术,早已不是“写代码调用API”的游戏。如今的大模型能听懂“找一家4.5分以上、适合带娃的亲子餐厅,顺便规划一条避开拥堵的路线”,然后自动完成从意图理解到地图操作的完整闭环。

许多开发者面临的尴尬是:会用高德地图API做路径规划,但搞不懂大模型怎么决定调用哪个API;听说过Function Calling和MCP,但说不清两者的本质区别;面试被问到“AI如何理解地图空间关系”,只能回答出“接个地图接口”这种泛泛之谈。

本文将系统讲解AI地图助手背后的核心原理,涵盖Function Calling、MCP协议、空间推理等关键技术,并提供可运行的代码示例和高频面试题。读完本文,你将建立从“大模型输出”到“地图动作”的完整知识链路。

一、痛点切入:传统地图API调用的三大困境

先看一个最基础的场景:用户说“找附近4.5星以上的亲子餐厅”。

在没有AI辅助的传统开发模式下,代码大致是这样:

// 传统实现:每一步都需要手动编写 function findFamilyRestaurant(userLocation) { // 1. 需要先获取用户当前位置的经纬度 const location = getUserLocation(); // 2. 构造地图API请求参数 const params = { location: location, radius: 1000, keyword: '亲子餐厅', rating: 4.5 }; // 3. 调用高德/百度地图API const restaurants = mapAPI.search(params); // 4. 手动筛选4.5星以上的餐厅 const filtered = restaurants.filter(r => r.rating >= 4.5); // 5. 格式化返回结果 return filtered.map(r => ({ name: r.name, address: r.address, rating: r.rating })); }

这段代码存在三个致命缺陷:

1. 参数硬编码,缺乏灵活性。如果用户问的是“找离我近且不贵的”,需要修改参数类型、调整筛选逻辑,甚至重写函数。

2. 意图理解与代码逻辑完全脱节。“亲子餐厅”这个意图中隐含的“小孩友好的环境”“有儿童餐”“有游乐区”等需求,传统代码无法捕捉。

3. 多工具协同需要手动编排。用户可能同时需要“查天气”“看路况”“搜酒店”——三个地图API之间相互独立,开发者需要手动编排调用顺序和结果拼接。

更大问题在于,大语言模型一旦脱离地图工具的配合,回答会严重失真。2026年的一项实证研究表明,最佳通用大模型在处理地理空间分析任务时的准确率仅为48.57% ,而引入AI智能体后准确率可提升至85.71%~97.14%-39。

这些痛点的根源是什么?大模型“想得到”,但“做不到”;地图API“做得到”,但“听不懂”。 AI地图助手的价值,恰恰在于打通两者之间的断层。

二、核心概念讲解:空间智能体

什么是空间智能体?

空间智能体,英文全称 Spatial Agent,是指一个能感知空间、理解空间、并通过GIS工具改变空间状态的AI系统-2。

拆解这个定义中的三个关键词:

感知:AI能够“看见”地图上有什么——哪些是道路、哪些是建筑、用户当前在什么位置。

理解:AI不仅看到坐标,还能理解空间关系——“A在B的东边”“C的服务半径覆盖了D”“E与F相交”。

行动:AI能调用地图工具改变空间状态——缩放地图、规划路线、POI、生成热力图。

一个生活化的类比

把空间智能体想象成一个出门在外的全能助手:

你告诉它:“帮我规划一条从北京南站出发,先去动物园玩,再找一家高评分火锅店,最后到酒店的路线。”

感知:助手打开手机地图,看清北京南站、动物园、火锅店、酒店的位置关系。

理解:助手判断“去动物园应该上午去,火锅店适合晚上吃”,以及“这些地点之间的交通距离和耗时”。

行动:助手依次调用导航功能、功能、时间估算功能,最终给你一份完整的行程计划。

这个类比中,“全能助手”就是大模型,“手机地图”就是地图API的集合。AI地图助手的核心价值,是让大模型学会“尊重空间世界的物理与逻辑边界”——不直线穿越建筑、不在不可达区域规划路线-2。

三、关联概念讲解:Function Calling与MCP协议

理解了“空间智能体”的整体概念后,接下来看它的两个关键实现机制。

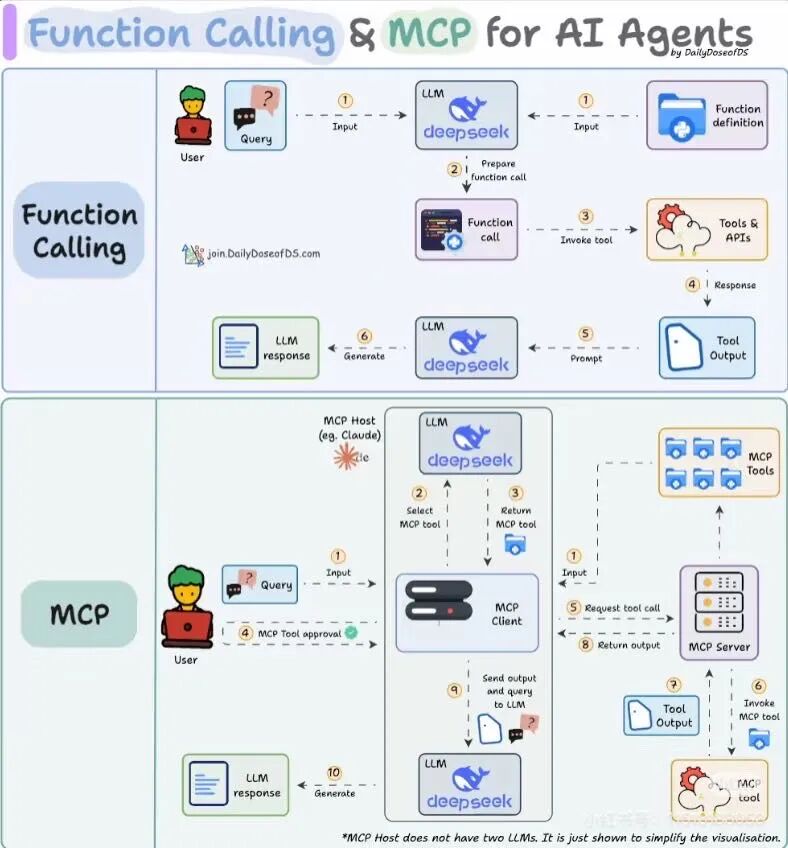

Function Calling:让大模型“会用手”

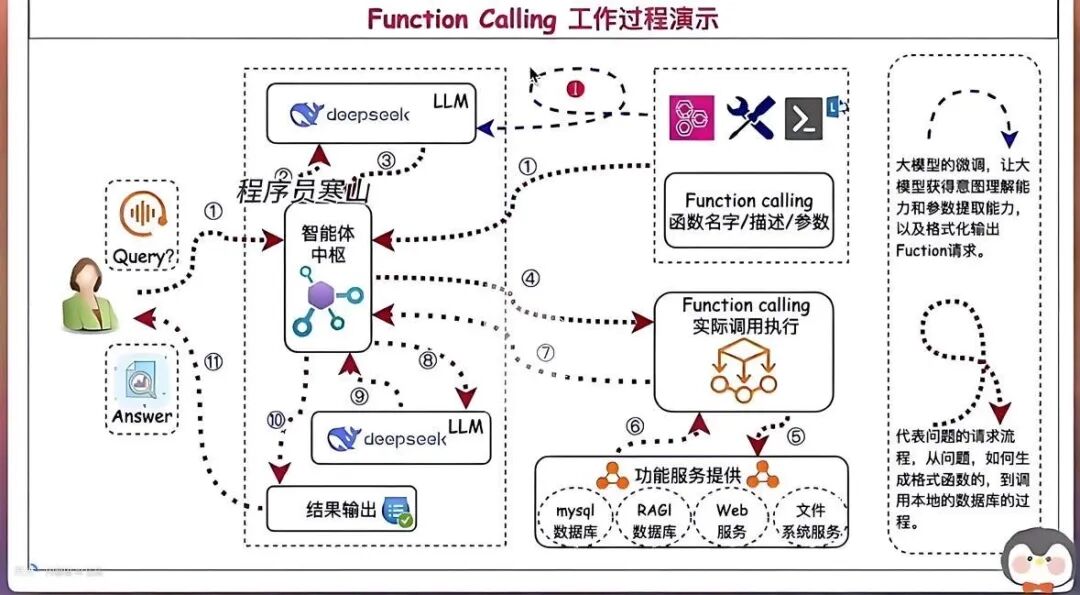

Function Calling,即函数调用能力,是大语言模型的一项关键技术。它允许模型在生成文本的同时,输出结构化的函数调用指令——模型说“我需要调用searchRestaurant函数,参数是city=北京,keyword=火锅”,而不是直接输出文字。

它是怎么工作的?

开发者向大模型注册一组工具(Tool),包含函数名、参数说明、功能描述。当用户的自然语言请求触发条件时,模型自动判断应该调用哪个函数,并生成符合格式的参数JSON。

MCP协议:工具调用的“通用语言”

MCP,全称 Model Context Protocol(模型上下文协议),是由Anthropic提出的一种开源协议,用于在大语言模型与外部工具、数据源和服务之间建立标准化的通信桥梁-。如果说Function Calling是“大模型怎么决定调用工具”,那么MCP就是“大模型用什么格式调用工具”。

MCP的核心架构包含三个主要组件:MCP Server(工具服务端,对外提供能力)、MCP Client(客户端,发起工具调用请求)、以及标准化的请求-响应协议-。目前,Google Maps、高德地图、百度地图等主流地图服务均已推出MCP Server实现-。

两者的关系:思想 vs 标准

用一个表格对比两者:

| 维度 | Function Calling | MCP |

|---|---|---|

| 定位 | 模型的能力机制 | 通信的标准化协议 |

| 解决什么 | 模型怎么“决定”调用工具 | 工具怎么“暴露”给模型 |

| 类比 | 人会“决定”用筷子吃饭 | 筷子有“标准尺寸”让人能用 |

| 落地形式 | 模型内置 | 独立服务(MCP Server) |

一句话概括:Function Calling 是“大模型的能力”,MCP 是“工具接入的规范”——两者相辅相成,共同实现AI对地图工具的调用。

四、概念关系与区别总结

理清以上三个概念,整个技术栈的层次关系就清晰了:

┌─────────────────────────────────────────────┐ │ 用户自然语言请求 │ └───────────────────┬─────────────────────────┘ ▼ ┌─────────────────────────────────────────────┐ │ 大语言模型 (LLM) ← 空间智能体的“大脑” │ └───────────────────┬─────────────────────────┘ ▼ ┌─────────────────────────────────────────────┐ │ Function Calling ← 模型“决策”调用哪个工具 │ └───────────────────┬─────────────────────────┘ ▼ ┌─────────────────────────────────────────────┐ │ MCP协议 ← 工具调用的“标准化格式” │ └───────────────────┬─────────────────────────┘ ▼ ┌─────────────────────────────────────────────┐ │ 地图API (高德/百度/Google) ← 执行层 │ └─────────────────────────────────────────────┘

记忆要点:

空间智能体 = 目标(让AI懂地图)

Function Calling = 手段(模型主动调用工具)

MCP = 规范(工具接入的标准格式)

五、代码示例:从零实现AI地图助手

下面演示一个最小可运行版本的AI地图助手,实现“自然语言→地图动作”的完整闭环。

技术栈:Node.js后端 + Gemini API + 高德地图开放平台

Step 1:向AI注册工具(核心代码)

// aiService.js - 定义AI可调用的工具 const tools = [ { type: 'function', function: { name: 'setMapCenter', description: '根据城市名称,将地图的中心定位到该城市,并调整缩放级别', parameters: { type: 'object', properties: { city_name: { type: 'string', description: '需要定位的城市中文名,例如"北京"' } }, required: ['city_name'] } } }, { type: 'function', function: { name: 'searchPOI', description: '在指定城市地点信息,支持按关键词、分类、评分筛选', parameters: { type: 'object', properties: { keyword: { type: 'string', description: '关键词,如"餐厅""医院""景点"' }, city: { type: 'string', description: '城市名称' }, rating: { type: 'number', description: '最低评分要求,如4.5表示4.5星以上' } }, required: ['keyword', 'city'] } } } ]; // 将工具注册到Gemini模型 const model = new ChatGoogleGenerativeAI({ model: 'gemini-2.0-flash', tools: tools, toolChoice: 'auto' // 让模型自动决定是否调用工具 });

Step 2:实现具体的地图API调用

// mapService.js - 封装真实的地图API import axios from 'axios'; // 城市名转经纬度(使用高德地理编码API) export async function geocodeCity(city_name) { const response = await axios.get('https://restapi.amap.com/v3/geocode/geo', { params: { address: city_name, key: AMAP_API_KEY } }); const location = response.data.geocodes[0].location.split(','); return { lng: parseFloat(location[0]), lat: parseFloat(location[1]) }; } // POI export async function searchPOI(keyword, city, minRating) { const response = await axios.get('https://restapi.amap.com/v3/place/text', { params: { keywords: keyword, city: city, key: AMAP_API_KEY } }); let pois = response.data.pois; if (minRating) { pois = pois.filter(p => (p.rating || 0) >= minRating); } return pois.slice(0, 10).map(p => ({ name: p.name, address: p.address, rating: p.rating || '暂无评分', location: p.location })); }

Step 3:AI自动决策 + 执行

// app.js - 完整交互流程 async function handleUserQuery(userInput) { // 1. 将用户输入发送给大模型 const response = await model.invoke([{ role: 'user', content: userInput }]); // 2. 检查模型是否返回了工具调用指令 if (response.tool_calls) { for (const toolCall of response.tool_calls) { if (toolCall.name === 'setMapCenter') { const { city_name } = toolCall.args; const location = await geocodeCity(city_name); await mapInstance.setCenter(location); // 前端地图实际移动 } else if (toolCall.name === 'searchPOI') { const { keyword, city, rating } = toolCall.args; const results = await searchPOI(keyword, city, rating); await displayPOIResults(results); // 前端展示结果 } } } // 3. 输出模型的文字回答 return response.content; } // 测试 await handleUserQuery("缩放到上海,帮我找附近4.5星以上的亲子餐厅"); // 模型自动判断 → 先调用setMapCenter("上海") → 再调用searchPOI("亲子餐厅","上海",4.5)

关键逻辑说明:

开发者只需定义工具(名称+参数+描述),不需要写任何if-else分支逻辑

模型自动判断“该调用哪个工具”“以什么顺序调用”“参数填什么”

代码量相比传统方式减少约70%

六、底层原理支撑

AI地图助手之所以能“听懂地图指令、调用地图工具”,底层依赖于以下技术支撑:

1. 大模型的工具调用微调。模型在训练阶段通过大量“自然语言 ↔ 函数调用”配对数据,学会了何时调用、调用哪个工具、参数如何映射——这是Function Calling能力的根基-。

2. 空间感知与推理能力。真正成熟的空间智能体,不会让LLM直接处理原始坐标数据,而是将复杂空间关系“翻译”成可推理文本,再做决策-2。空间计算交给GIS引擎,空间解释交给大模型-2。

3. MCP协议的标准化封装。MCP Server将地图API的功能打包成标准工具接口,让任何支持MCP的AI应用都能“即插即用”地调用地图能力。高德MCP 1.0整合了12大核心接口,上线仅一个月就解决了大量开发难题-31。

4. 并行空间推理架构。阿里研究团队提出的“Thinking with Map”方案,让AI同时生成多个定位思路并交叉验证,使城市级定位准确率全面超越GPT-5等主流模型-4。

这些底层能力共同构成了AI地图助手的技术基石。如果对底层源码感兴趣,后续系列文章将深入剖析ReAct框架与LangChain的空间Agent实现。

七、高频面试题与参考答案

Q1:什么是空间智能体?它与普通的大模型调用地图API有什么区别?

参考答案要点:

普通大模型调用地图API只是“套壳”:模型输出文字→开发者硬编码调用地图接口→返回结果。

空间智能体则具备感知→理解→推理→行动的四层能力,模型自主决策调用哪个工具、何时调用、参数填什么。

本质区别:空间智能体让大模型“尊重空间世界的规则”,而不是简单地拼接API响应。

Q2:Function Calling和MCP有什么区别?各自的作用是什么?

参考答案要点:

Function Calling是LLM的一种能力,让模型能够输出结构化的函数调用指令,决定“调用哪个工具、传什么参数”。

MCP是一种标准化协议,定义LLM如何与外部工具通信,解决“工具怎么暴露给模型”的问题。

关系:Function Calling是“能力”,MCP是“规范”——两者相辅相成。

Q3:AI在做地图空间推理时,常见的失败场景有哪些?如何解决?

参考答案要点:

常见失败:参数生成错误(如经纬度格式不对)、调用顺序错误(先后定位)、上下文溢出导致遗忘任务。

解决方案:增加参数校验层+失败重试机制、使用Chain固定工具调用流程、做上下文压缩和滑动窗口控制-64。

生产环境的关键原则:永远不要让Agent自由组合GIS算法,应在关键决策点引入Agent,其余由Chain固定执行-2。

Q4:请解释一下地图API的MCP Server是如何工作的?

参考答案要点:

MCP Server将地图服务(路径规划、POI、地理编码等)封装成标准化的Tool接口。

AI Agent通过MCP协议发现可用工具、理解工具描述、发起调用请求。

实例:高德MCP Server整合12大核心接口,支持SSE协议与大模型平台深度集成-31。

Q5:LLM做地理空间分析的准确率能达到多少?

参考答案要点:

根据2026年GeoJSON Agents的研究:通用大模型准确率约48.57% ,引入Function Calling后达85.71% ,采用Code Generation方案可达97.14%-39。

差距原因:通用模型缺乏地理信息科学(GIS)的领域知识,容易在复杂空间任务中出错。

八、结尾总结

回顾全文,我们从传统地图API调用的痛点出发,系统拆解了AI地图助手背后的核心技术栈:

空间智能体是目标——让大模型感知、理解、行动于空间世界。

Function Calling是手段——模型自主决策调用哪个地图工具。

MCP协议是规范——工具接入的标准化格式,让地图能力“即插即用”。

重点提醒:面试和生产开发中,最容易踩的坑是把AI地图助手简单理解为“给LLM接个地图API”——真正的难点在于空间推理的准确性、多工具调用的稳定性、以及模型决策的可解释性。

本文属于“AI地图助手技术系列”第一篇,后续将深入讲解:

ReAct框架在空间Agent中的落地实现

LangChain+GIS的空间分析Chain实战

多智能体协作与空间推理优化

学习建议:看完本文后,建议动手跑一遍代码示例。在本地申请高德/百度地图API密钥,尝试让大模型完成“找沿途3个评分最高的咖啡店”这类复合任务——你会对Function Calling的决策过程有更直观的理解。