2026年4月9日 星期四

引言

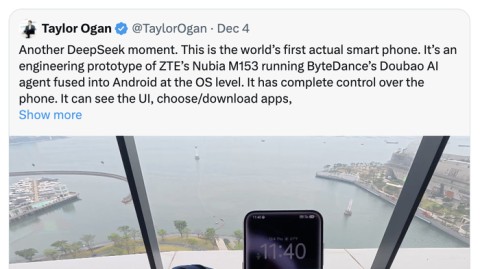

AI助手技术正经历从“被动响应”到“自主执行”的范式跃迁。

许多开发者在使用这类产品时存在明显痛点:

一、痛点切入:传统实现的局限性

在AI助手出现之前,要让手机自动完成多步操作,通常需要以下方式:

传统方式:硬编码脚本 def buy_coffee(): 步骤1:打开外卖APP 步骤2:咖啡店 步骤3:选择商品 步骤4:下单支付 每个步骤都需要手动编写UI点击逻辑 一旦APP改版,整个脚本失效

传统方式的三大缺陷:

耦合度高:代码与特定APP界面深度绑定,换一个APP就得重写

扩展性差:新增一个操作场景需要从头开发

维护成本高:APP版本更新可能导致整个流程失效

正是这些痛点,催生了基于大语言模型的AI助手技术。

二、核心概念讲解:AI Agent

定义:AI Agent(人工智能体)是指能够理解用户目标、自主规划执行路径、调用外部工具并完成复杂任务的智能系统。-48

从技术架构看,AI Agent由三个层次构成:

推理层:基于大语言模型(LLM)实现目标理解与决策规划

编排层:负责多步骤任务的执行顺序与资源调度

应用层:通过工具调用、API连接等方式与外部环境交互-48

生活化类比:LLM像一个读过万卷书的理论家,能回答问题、分析问题;而Agent则是一位不仅懂理论、还能实际动手解决问题的工程师——它自己上网查资料、写代码、跑测试、发邮件,完整执行一项任务。

三、关联概念讲解:Function Call

定义:Function Call(函数调用)是AI模型中允许大语言模型识别用户意图后,主动调用外部API函数获取实时数据或执行操作的机制。-22

与LLM的关系:Function Call是实现AI Agent能力的核心技术手段。Agent依赖Function Call来“动手做事”,LLM提供“动脑思考”的能力。

关键要点:调用三方API不是通过提示词(Prompt)来实现的,而是通过函数调用机制-22。具体流程分为五步:

模型识别调用需求:大模型判断是否需要调用API

API方法注册:开发者预先定义函数名称、参数(JSON Schema)、描述信息

大模型生成调用请求:解析用户输入,输出结构化调用参数

程序执行API并返回结果

大模型解析结果生成自然语言回复-22

注册一个获取天气的函数 { "name": "get_weather", "description": "获取某个城市的天气信息", "parameters": { "type": "object", "properties": { "city": {"type": "string", "description": "城市名称"} }, "required": ["city"] } }

当用户问“北京今天的天气怎么样?”,大模型会输出:{"name": "get_weather", "arguments": {"city": "北京"}}

四、概念关系与区别总结

| 概念 | 角色定位 | 核心能力 | 一句话总结 |

|---|---|---|---|

| LLM | 大脑(思考) | 文本理解与生成 | 能说会道,但不一定能做 |

| AI Agent | 完整智能体(思考+行动) | 目标理解→规划→执行 | 能干活的AI |

| Function Call | 行动机制(动手) | 调用外部API/工具 | 让AI连接世界的“手臂” |

记忆口诀:LLM是大脑,Agent是完整的人,Function Call是手。

五、代码示例:实战演示

以下是一个简化的AI Agent实现,展示如何整合LLM与Function Call:

示例:基于Function Call的AI助手核心逻辑 步骤1:定义可用工具函数 def search_web(query): """调用引擎""" print(f"[执行] :{query}") return f"结果:关于'{query}'的相关信息..." def send_email(recipient, content): """发送邮件""" print(f"[执行] 发送邮件给{recipient}") return "邮件已发送" 步骤2:注册工具函数(模拟Function Call注册) TOOLS = [ {"name": "search_web", "func": search_web, "description": "网页信息"}, {"name": "send_email", "func": send_email, "description": "发送邮件"} ] 步骤3:Agent执行循环 def run_agent(user_input): 1. LLM解析用户意图 intent = parse_intent(user_input) 输出:{"tool": "search_web", "args": {"query": "..."}} 2. 执行对应工具函数 if intent["tool"] in TOOLS_MAP: result = TOOLS_MAP[intent["tool"]](intent["args"]) 3. LLM生成最终回复 return generate_response(result) 用户输入:"帮我查一下今天的AI新闻,然后发邮件告诉小明" run_agent("帮我查AI新闻并告诉小明") 输出:[执行] :AI新闻 [执行] 发送邮件给小明 [回复] 已为您查询并发送邮件

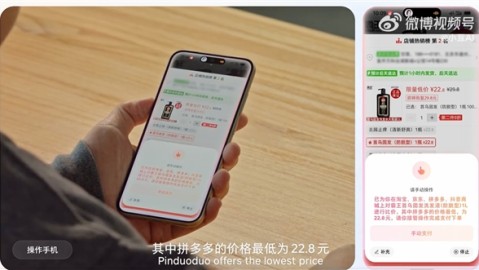

锤子AI助手J1的典型场景:用户语音指令“查阅湖人队剩余赛程,如有对阵勇士队的比赛,请记下并提前30分钟提醒”-2。J1通过自然语言理解、意图解析、工具调用(日历/提醒/),自动完成整个任务链。

六、底层原理支撑

锤子AI助手的技术支撑主要包括以下层面:

1. Function Call机制:J1 Assistant的技术主要集中在Function Call模型上,通过函数调用调用外部服务来完成各类任务。-14

2. Agent架构三层模型:

推理层:基于大语言模型实现目标理解与决策规划

编排层:负责多步骤任务的执行顺序与资源调度

应用层:通过工具调用、API连接与外部环境交互-48

3. RAG技术:对于需要特定领域知识的场景,RAG(检索增强生成)技术可以大幅提升AI回答的准确性和可解释性。-15

这些底层技术共同支撑了锤子AI助手的智能交互与自动化能力。

七、高频面试题与参考答案

Q1:LLM和AI Agent有什么区别?

参考答案:LLM(大语言模型)是Agent的“大脑”,负责文本理解与生成,但它不能主动调用工具或执行任务。AI Agent在LLM基础上增加了规划、记忆和工具调用能力,形成一个能够自主完成复杂任务的闭环系统。Agent = LLM + 规划 + 记忆 + 工具。

Q2:Function Call的工作原理是什么?

参考答案:Function Call的核心流程包括:(1)开发者预先注册API函数,提供函数名、参数JSON Schema和描述;(2)大模型解析用户输入,判断是否需要调用API;(3)模型输出结构化调用请求;(4)程序执行实际API并返回结果;(5)大模型将结果整合成自然语言回复。关键点是:这不是通过Prompt实现的,而是专门的函数调用机制。

Q3:AI Agent的技术架构通常包含哪些层次?

参考答案:Agent的三层架构包括:(1)推理层——基于LLM实现目标理解与决策规划;(2)编排层——负责任务执行顺序与资源调度;(3)应用层——通过工具调用、API连接与外部环境交互。

Q4:RAG技术解决了什么问题?

参考答案:通用大模型依赖静态训练数据,无法回答未训练过或实时变化的问题。RAG(检索增强生成)通过实时检索外部知识库,将检索结果注入提示词中,让模型基于实时信息生成回答,大幅提升了准确性和可解释性。

八、结尾总结

本文全面解析了锤子AI助手背后的核心技术体系:

✅ 核心概念:AI Agent是能够自主执行任务的智能体,由LLM驱动

✅ 关键技术:Function Call是实现工具调用的核心机制

✅ 底层支撑:三层架构 + RAG技术

✅ 高频考点:LLM vs Agent、Function Call流程、Agent三层架构

建议读者将本文内容与实战代码结合,逐步构建自己的AI Agent应用。下一篇文章将深入讲解LangChain框架的实战应用,敬请期待。

参考资料:J1 Assistant技术解析、AI Agent架构白皮书、Function Call开发规范等。