2026年4月10日,北京 | 技术入门/进阶学习、面试备考与技术决策必读

一、开篇引入

二、痛点切入:为什么需要AI店铺助手

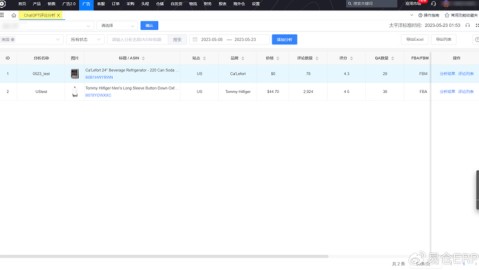

传统的电商客服与店铺管理,长期依赖规则式(Rule-based)聊天机器人——就像“按剧本念台词的演员”-11。以下是一段典型的旧实现伪代码:

传统规则式方案示例 if "物流" in user_input: reply = "您的订单已发货,物流单号请稍后..." elif "退款" in user_input: reply = "请提供订单号,我们将为您处理..." else: reply = "抱歉,我无法理解您的问题,请转人工"

这种方案存在显著缺陷:

意图识别能力有限:依赖关键词匹配,对自然语言表达几乎无效-11

无法处理多轮对话:缺乏上下文理解与长期记忆能力

工具调用能力为零:不能自主查询订单、修改商品、屏蔽恶意顾客

维护成本高:每增加一个场景都需要手动扩充规则

正是在这一背景下,AI店铺助手应运而生——它基于大语言模型(Large Language Model,LLM),通过Agent架构赋予系统感知→决策→执行的全链路自主能力。

三、核心概念讲解:AI Agent(智能体)

定义

AI Agent(人工智能智能体) 是一个自主系统,它能够感知环境、做出决策并执行行动以实现目标,且几乎不需要人工干预-。

拆解关键词

感知:通过LLM理解用户输入的自然语言(含模糊表达、多轮上下文)

决策:利用推理能力规划行动路径,决定调用哪个工具、生成什么回答

执行:调用系统接口(API)完成具体操作,如查订单、改库存、发优惠券

生活化类比

AI Agent就像一个配有秘书(LLM)和工具箱(API)的私人助理。你告诉他“帮我查一下今天哪款商品卖得最好”,他先理解你的需求(LLM理解),然后打开数据系统查询(工具调用),最后把结果用通顺的话告诉你(LLM生成)。整个过程中,你不需要告诉他“先去哪个数据库、用什么SQL语句”。

核心作用

AI Agent将智能客服从“成本优化工具”加速转型为“品牌增长引擎”-11。在AI店铺助手场景中,它可实现订单查询、商品管理、屏蔽恶意顾客等指令的语音或文本操作-1。

四、关联概念讲解:Multi-Agent(多智能体系统)

定义

Multi-Agent System(多智能体系统) 指由多个独立但相互协作的AI Agent组成的系统,每个Agent承担特定职责,通过通信协议协同完成复杂任务-15。

Multi-Agent的设计动机

“Agent模拟的是现实世界的人的解决问题过程”-15。想象一家电商店铺的真实团队:有客服专员、导购顾问、数据分析师、运营专员——各司其职又协同作战。Multi-Agent正是对这一组织模式的算法映射。

典型架构:Master + Sub-Agents 协同模式

在京东京麦智能助手的实践中,采用了Master Agent + Sub-Agents的分层架构-15:

| Agent类型 | 职责 | 示例 |

|---|---|---|

| Master Agent | 领域层面任务规划,将复杂场景拆解为子任务 | 将“帮我分析上周销售数据并推荐补货策略”拆解为数据分析+补货推荐两个子任务 |

| Sub-Agents | 执行具体子任务,各司其职 | 数据分析Agent负责跑数据,补货推荐Agent基于数据给出建议 |

五、概念关系与区别总结

| 维度 | AI Agent | Multi-Agent |

|---|---|---|

| 定位 | 思想/个体 | 实现/系统 |

| 组成 | 单个智能体 | 多个智能体的协作网络 |

| 适用场景 | 单一域、流程清晰的任务 | 跨域、流程复杂的复合任务 |

| 复杂度 | 较低 | 较高 |

| 核心挑战 | 推理准确性、工具调用可靠性 | 任务拆解、Agent间通信、状态同步 |

一句话概括:Agent是“一个能干活的人”,Multi-Agent是“一群分工协作的人组成的团队”。

六、代码/流程示例演示

以下是一个简化的AI店铺助手Agent实现(基于LangGraph框架,LangGraph是有向图工作流编排框架):

基于LangGraph的AI店铺助手核心节点示例 from langgraph.graph import StateGraph, END from typing import TypedDict, List class StoreState(TypedDict): query: str 用户查询 intent: str 识别的意图 tool_result: dict 工具调用结果 final_response: str 最终回复 定义三个核心节点 def recognize_intent(state: StoreState): """Step 1: LLM识别用户意图""" if "订单" in state["query"]: state["intent"] = "order_query" elif "商品" in state["query"] and "上架" in state["query"]: state["intent"] = "product_list" else: state["intent"] = "general_chat" return state def call_tool(state: StoreState): """Step 2: 调用对应工具""" if state["intent"] == "order_query": state["tool_result"] = {"status": "shipped", "tracking": "SF123456"} elif state["intent"] == "product_list": state["tool_result"] = {"product": "新款T恤", "status": "已上架"} return state def generate_response(state: StoreState): """Step 3: LLM生成最终回复""" if state["tool_result"]: state["final_response"] = f"已为您处理:{state['tool_result']}" else: state["final_response"] = "请具体描述您的需求" return state 构建工作流图 graph = StateGraph(StoreState) graph.add_node("recognize", recognize_intent) graph.add_node("call_tool", call_tool) graph.add_node("respond", generate_response) graph.set_entry_point("recognize") graph.add_edge("recognize", "call_tool") graph.add_edge("call_tool", "respond") graph.add_edge("respond", END) 执行示例 app = graph.compile() result = app.invoke({"query": "帮我查一下订单发货状态"}) print(result["final_response"]) 输出:已为您处理:{'status': 'shipped', ...}

执行流程说明:

recognize_intent:LLM识别用户“查订单”的意图call_tool:根据意图调用订单查询APIgenerate_response:LLM将查询结果转化为自然语言回复

通过LangGraph用有向无环图固化主流程,既压缩token成本,又保留人工可干预的“白盒”边界-。

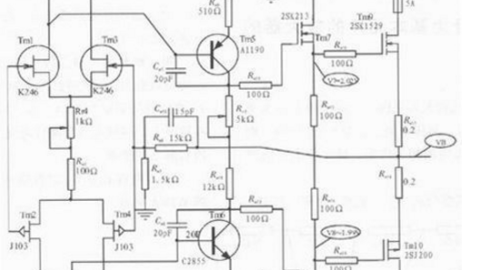

七、底层原理/技术支撑

AI店铺助手Agent的核心能力依赖于以下底层技术栈:

| 技术组件 | 支撑功能 | 关键技术点 |

|---|---|---|

| LLM(大语言模型) | 意图理解与自然语言生成 | 基于Transformer架构,支持128K以上上下文窗口 |

| RAG(检索增强生成,Retrieval-Augmented Generation) | 知识库问答 | 将商家知识库存入向量数据库,先检索后生成,准确率可达93%以上 |

| Function Calling / Tool Use | 调用外部系统 | 模型输出结构化API调用参数,经API网关执行 |

| ReAct(Reasoning + Acting)范式 | 推理与行动循环 | “思考→行动→观察”迭代,实现复杂任务规划-15 |

| 图工作流编排(如LangGraph) | Multi-Agent调度 | 有向无环图固化流程,支持动态路由 |

RAG技术的核心价值:以台湾电商龙头momo为例,其AI客服系统结合Azure OpenAI与RAG技术,回复正确率已超过90%-40。

八、高频面试题与参考答案

1. 什么是AI Agent?它与传统聊天机器人有什么区别?

标准答案:AI Agent是能自主感知环境、做出决策并执行行动的智能系统。区别有三:①决策能力:Agent基于LLM推理,规则机器人依赖预设规则;②工具调用:Agent可自主调用API完成操作,规则机器人只能回答;③持续学习:Agent支持上下文记忆和多轮对话。

2. 为什么要用Multi-Agent而不是单一Agent?

标准答案:单一Agent在处理跨域复杂任务时存在三大瓶颈:①任务耦合度高:一个模型同时承担意图识别、工具调用、回复生成,相互干扰;②幻觉率偏高:模型在多种任务间切换易出错;③可维护性差:修改一个能力可能影响整体。Multi-Agent将任务分而治之,Master Agent负责拆解,Sub-Agents各司其职,显著提升准确率与可维护性-15。Shopify的实践表明,转向Multi-Agent后输出质量翻倍、LLM单位成本降低75倍-5。

3. 如何解决LLM在工具调用中的幻觉问题?

标准答案:可从三个层面解决:①引入Embedding快速匹配:用向量匹配替代LLM直接选择工具,避免选择幻觉-15;②构建Tools DAG:用有向无环图约束工具调用路径,确保调用逻辑性-15;③采用ReAct范式:每一步执行后根据结果动态调整,形成“思考→行动→观察”闭环-15。

4. AI店铺助手中RAG和Agent是什么关系?

标准答案:RAG是Agent的知识获取机制,Agent是整体决策框架。当用户询问商品参数时,Agent先通过RAG从知识库检索相关信息,再由LLM生成精准回答。二者协同:RAG保证回答的事实准确性,Agent负责判断何时需要检索、如何组合检索结果与推理结果。

5. 如何设计一个电商场景的Multi-Agent架构?

标准答案:参考主流方案(如京东京小智5.0的四大Agent矩阵-11、阿里妈妈AI万相-2),建议设计:意图识别Agent(解析用户需求)、商品推荐Agent(匹配SKU)、订单处理Agent(调用交易系统)、客服应答Agent(生成回复)。Master Agent负责任务路由,各Agent通过标准通信协议协作,并支持人机协同的兜底机制。

九、结尾总结

本文围绕 AI店铺助手 这一核心主题,系统梳理了从AI Agent到Multi-Agent的完整知识链路:

概念层:Agent是自主智能体,Multi-Agent是多智能体协作系统,二者是“个体vs团队”的关系

实现层:基于LangGraph等编排框架,配合RAG与Function Calling实现“感知→决策→执行”闭环

原理层:底层依赖LLM、RAG向量检索、ReAct推理范式等技术栈

面试层:重点掌握概念辨析、Multi-Agent设计动机、幻觉治理策略

易错点提醒:不要把“AI店铺助手”简单等同于聊天机器人——它核心在于自主执行能力;也不要混淆Agent与Multi-Agent——面试中常考二者的适用场景对比。

预告:下一篇将深入RAG在电商场景的进阶应用,包括知识图谱增强检索(Graph-RAG)与自进化Agent设计。欢迎持续关注本系列,评论区留下你关心的技术方向!