本文发表于

一、引言:为什么人脸识别是所有AI人脸智能助手的“眼睛”

当你对着手机屏幕刷脸支付、通过小区门禁“刷脸”通行、或在政务大厅被AI助手识别身份时,背后支撑这一切的,正是人脸识别技术。它是

不少开发者在使用人脸识别功能时,往往存在一个认知误区:以为它只是“拍张照片比一比”。实际上,人脸识别的底层逻辑远比肉眼所见复杂得多,它本质是一套完整的“AI识人”流程,而非简单的图像比对-4。只会调用API、不懂原理、遇到问题不知道如何调优——这些正是很多学习者的真实痛点。

本文将从原理到实践,由浅入深地带你全面掌握AI人脸智能助手背后的核心技术。无论你是准备面试、搭建项目,还是深入理解底层逻辑,这篇都能帮你建立完整的知识链路。

二、痛点切入:为什么需要人脸识别技术

传统身份验证方式的局限

先来看一段传统的身份验证逻辑:

传统方案:密码验证 def authenticate_user(input_password, stored_password): if input_password == stored_password: return "验证通过" else: return "密码错误"

这段代码有什么问题?

依赖用户记忆:密码容易遗忘,用户被迫使用简单密码

易被窃取:密码可通过网络攻击、社会工程学手段获取

不区分“谁在用” :知道密码就能通过,无法验证是否为本人

体验割裂:每次验证都需要用户主动输入,无法实现无感体验

人脸识别的价值

正是为了攻克这些痛点,人脸识别技术应运而生。它让系统能够以生物特征代替知识凭证——你的脸就是密码,不用记、不易丢、难以复制。一次自然的“看一眼”,就能完成身份核验,这正是AI人脸智能助手实现无感交互的关键能力。

三、核心概念讲解:人脸识别与人脸检测

人脸识别

人脸识别(Face Recognition,简称FR) 是指通过算法自动检测图像中的人脸,并将其与人脸数据库中的特征进行比对,以确定或验证个体身份的技术。

用一句话概括:人脸识别解决的是“这人是谁”的问题。

关键技术环节拆解:

人脸检测:从图像中找到人脸的位置

人脸对齐:将人脸校正到标准姿态

特征提取:将面部特征转化为可比的数学向量

特征比对:计算特征向量之间的相似度

根据应用场景不同,人脸识别又可分为两类:

1:1 人脸验证:判断“这个人是不是他所声称的那个人”,典型场景如手机解锁、刷脸支付

1:N 人脸识别:从人脸库中找出“这个人是谁”,典型场景如安防监控、嫌疑人追踪

人脸检测

人脸检测(Face Detection,简称FD) 是指在图像或视频帧中定位并识别出所有人脸区域的过程,输出通常为人脸的边界框坐标。

用一句话概括:人脸检测解决的是“人脸的坐标在哪”的问题。

人脸检测是人脸识别的前置步骤——系统必须先知道“脸在哪里”,才能进行特征提取和比对。

两者关系

人脸检测是“找脸”,人脸识别是“认脸”。前者告诉你在哪,后者告诉你他是谁。

| 维度 | 人脸检测 | 人脸识别 |

|---|---|---|

| 核心问题 | 人脸的位置在哪? | 这个人是谁? |

| 输出结果 | 边界框坐标、关键点 | 身份ID、相似度分数 |

| 是否需要数据库 | 不需要 | 需要(特征库) |

| 算法复杂度 | 相对较低 | 相对较高 |

| 典型应用 | 美颜相机、自动对焦 | 门禁考勤、刷脸支付 |

四、关键算法与模型

1. FaceNet(Google Research)

FaceNet是Google于2015年提出的里程碑式人脸识别模型,核心思想是将人脸图像直接映射到128维欧几里得空间的嵌入向量,使得相同身份的人脸距离更近,不同身份的人脸距离更远。

其关键技术——Triplet Loss——通过构建(Anchor, Positive, Negative)三元组,训练模型不断缩小正样本之间的距离、拉大负样本之间的距离-20。FaceNet在LFW数据集上达到99.63% 的准确率,特征向量维度仅128维,内存占用低,支持跨年龄、跨姿态的鲁棒识别-23。

2. ArcFace(腾讯优图)

ArcFace在Softmax基础上引入了角裕量机制。不同于FaceNet的欧氏空间距离度量,ArcFace在角度空间内施加加性角裕量,大幅增强了类间可分性和类内紧致性-20。

InsightFace(ArcFace的实现工具库)在IJB-C数据集上TAR@FAR=1e-6达到99.1% ,支持百万级人脸库的快速检索,提供C++/Python双语言SDK-23。

3. MTCNN(腾讯优图)

MTCNN(多任务级联卷积网络)采用三级网络级联结构:P-Net快速生成候选框 → R-Net进一步过滤 → O-Net精确定位和输出5个面部关键点。这种级联设计在WIDER FACE数据集上表现优异,尤其适合安防监控场景-20。

4. 算法对比总结

| 算法 | 核心机制 | 适用场景 | 准确率 |

|---|---|---|---|

| FaceNet | Triplet Loss + 128维嵌入 | 高精度特征提取、跨年龄识别 | 99.63% |

| ArcFace | 角裕量Softmax | 大规模人脸库检索、金融级认证 | 99.1%+ |

| MTCNN | 三级级联网络 | 安防监控、多人脸检测 | WIDER FACE SOTA |

| RetinaFace | 单阶段检测+SSH模块 | 小目标人脸、边缘设备部署 | FDDB AP 99.3% |

💡 选型建议:轻量级边缘设备选RetinaFace或MTCNN;云端大规模检索选ArcFace;跨姿态鲁棒识别选FaceNet。

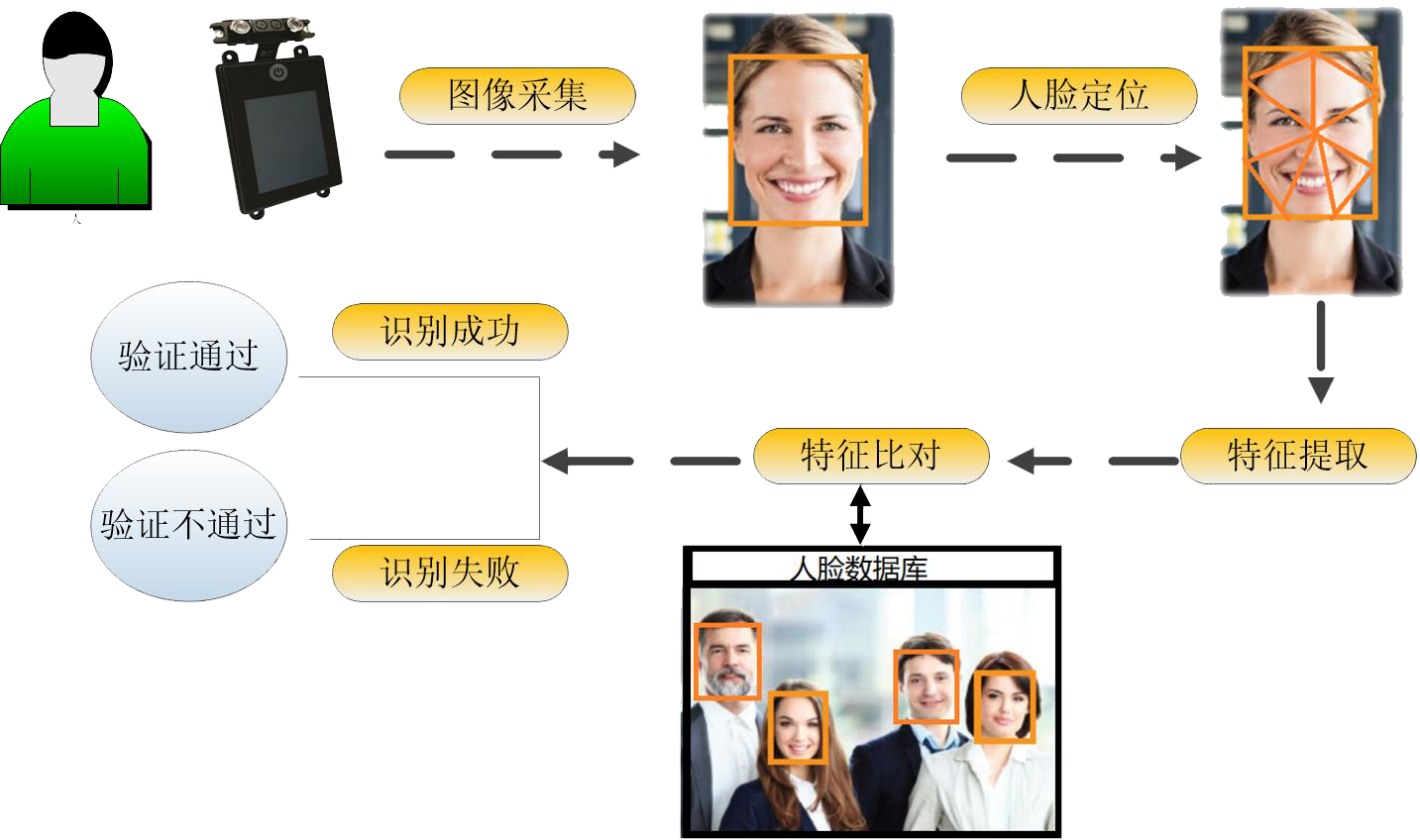

五、人脸识别的完整流程

一张人脸从输入到输出,需要经历以下五个关键步骤-4:

步骤1:目标检测

在原始图像中定位并框选出所有人脸区域。这一步通常由MTCNN、RetinaFace等检测模型完成。

步骤2:图像预处理

对检测到的人脸图像进行校正和标准化处理:

几何校正(旋转、缩放、仿射变换)

光照归一化

尺寸归一化(如对齐到112×112或160×160)

步骤3:特征提取

这是整个流程的核心环节。将预处理后的人脸图像输入深度学习网络(如FaceNet、ArcFace),输出一个高维特征向量。这个向量包含了面部数百个细微特征点信息——眼距、鼻梁高度、颧骨轮廓等,经转化后形成专属的数字代码,相当于每个人的“面部数字身份证”-4。

步骤4:特征比对

将提取的特征向量与数据库中存储的特征向量进行相似度计算。常用度量方式包括:

余弦相似度

欧氏距离

步骤5:结果输出

根据相似度分数与预设阈值的比较,输出身份验证结果或识别结果。

六、代码实战:从零搭建人脸识别系统

6.1 极简方案:Face Recognition库

import face_recognition 加载已知人脸和未知人脸 known_image = face_recognition.load_image_file("known_person.jpg") unknown_image = face_recognition.load_image_file("unknown_person.jpg") 提取128维特征向量 known_encoding = face_recognition.face_encodings(known_image)[0] unknown_encoding = face_recognition.face_encodings(unknown_image)[0] 比对两张人脸是否为同一人 results = face_recognition.compare_faces([known_encoding], unknown_encoding) distance = face_recognition.face_distance([known_encoding], unknown_encoding) print(f"是否为同一人: {results[0]}") True / False print(f"特征距离: {distance[0]:.4f}") 距离越小越相似

说明:face_recognition库底层基于dlib和ResNet-34,特征向量匹配速度达3200次/秒,适合中小规模人脸库(<10万)的场景-19。

6.2 高精度方案:InsightFace

from insightface.app import FaceAnalysis 初始化分析器 app = FaceAnalysis(allowed_modules=['detection', 'recognition']) app.prepare(ctx_id=0, det_size=(640, 640)) 检测并识别人脸 faces1 = app.get(img1) 返回包含特征向量的Face对象 faces2 = app.get(img2) if faces1 and faces2: 计算余弦相似度 similarity = faces1[0].norm_embed @ faces2[0].norm_embed.T print(f"相似度: {similarity[0][0]:.4f}")

说明:InsightFace集成了ArcFace算法,支持GPU加速,适合金融级高精度身份核验场景-23。

6.3 新旧对比:为什么推荐用深度学习方案?

旧方案:OpenCV Haar Cascade(仅检测,不能识别) face_cascade = cv2.CascadeClassifier('haarcascade_frontalface_default.xml') faces = face_cascade.detectMultiScale(gray, scaleFactor=1.1, minNeighbors=5) 新方案:深度学习(检测+识别一体化) from insightface.app import FaceAnalysis app = FaceAnalysis() app.prepare(ctx_id=0) faces = app.get(img) 一步完成检测、对齐、特征提取

优势对比:

旧方案:仅检测不识别;受光照影响大,逆光准确率下降12-15%-19;需要手动实现对齐和特征提取

新方案:端到端一体化流程;在LFW数据集上准确率超99.8%-23;内置GPU加速,处理速度快

七、底层原理支撑

人脸识别的高精度实现,离不开以下底层技术的支撑:

1. 深度学习

深度卷积神经网络是当前人脸识别技术的算法基石。CNN能够自动学习从像素到高层语义特征的分层表示,从边缘→纹理→五官→全局人脸逐步抽象,这是传统手工特征方法无法比拟的-11。

2. 度量学习

度量学习的核心思想是“好特征比好分类器更重要” 。通过Triplet Loss、ArcFace等损失函数,直接优化特征向量的空间分布,让同类人脸特征“聚拢”、异类人脸特征“分散”。

3. 迁移学习

利用在ImageNet等大规模数据集上预训练的模型(如ResNet-34、Inception-ResNet-v1),在人脸数据集上微调。这大幅降低了训练门槛,使中小团队也能获得高精度模型。

八、2025-2026年技术新趋势

趋势一:Transformer架构进军人脸识别

CNN在提取局部特征方面表现出色,但在捕捉全局面部特征和建模局部特征间相关性方面存在局限-11。TransFace++等方案开始探索Vision Transformer(ViT)在人脸识别中的应用,在精度和隐私保护方面取得了突破-11。

趋势二:隐私保护型人脸识别

CryptoFace提出了首个端到端全同态加密的人脸识别系统,可在特征提取、存储和匹配全流程中不暴露原始图像或特征向量,为隐私合规场景提供了新思路-13。

趋势三:大模型赋能人脸防伪

大湾区大学团队利用大模型关键技术,研发了更智能化、通用化的人脸活体检测技术,能秒速级识别出真实人脸与各类伪造攻击-。

趋势四:多模态融合识别

将RGB图像与红外、热成像等多模态数据融合,在不同光照、遮挡条件下保持高识别率。多模态大语言模型(MLLM)在异质人脸识别中的潜力正在被系统评估-30。

九、高频面试题与参考答案

Q1:人脸识别和人脸检测有什么区别?

参考答案:

人脸检测是定位图像中人脸位置的过程,输出边界框坐标;人脸识别是在检测基础上进行身份验证或辨识,输出身份ID。两者是先后关系——检测是前置步骤,识别是核心任务。通俗讲,检测是“找脸”,识别是“认脸”。

Q2:FaceNet的Triplet Loss是如何工作的?

参考答案:

Triplet Loss通过构建三元组(Anchor、Positive、Negative)训练网络:Anchor与Positive同属同一身份,Anchor与Negative属于不同身份。损失函数迫使Anchor与Positive距离尽可能小,与Negative距离尽可能大(至少大一个裕量margin)。最终学到的特征空间中,同类人脸聚拢、异类人脸分散。

Q3:人脸识别中如何应对光照变化和遮挡问题?

参考答案:

主要从三方面应对:1)预处理阶段采用直方图均衡化、Retinex等光照归一化方法;2)采用姿态不变的特征提取网络,如ArcFace在角度空间内学习判别特征;3)结合3D人脸信息或多模态数据(红外+可见光)增强鲁棒性。身高、体型、步态等全身信息也可作为辅助特征提升核验成功率-4。

Q4:活体检测有哪些常用方法?

参考答案:

活体检测用于防止照片、视频、面具等伪造攻击。常用方法包括:1)动作指令型:要求用户眨眼、张嘴、转头,判断动作是否自然连贯;2)炫彩活体检测:屏幕发出多色光,分析皮肤对光线的反射特性;3)深度学习型:基于CNN对采集图像进行时序分析,区分真实人脸与伪造攻击-。

Q5:特征向量的维度如何选择?维度越高越好吗?

参考答案:

特征向量维度需要权衡精度和效率。过低(如128维)可能无法充分表征人脸差异;过高(如1024维)会增加存储和计算开销,且可能出现过拟合。业界常用128维至512维,具体根据应用场景选择。FaceNet使用128维在精度与效率间取得良好平衡-23。

十、结尾总结

本文围绕AI人脸智能助手的核心技术——人脸识别,系统梳理了以下内容:

✅ 核心概念:人脸检测 vs 人脸识别,前者“找脸”,后者“认脸”

✅ 关键算法:FaceNet(Triplet Loss)、ArcFace(角裕量)、MTCNN(级联网络)

✅ 完整流程:目标检测→图像预处理→特征提取→特征比对→结果输出

✅ 代码实战:从Face Recognition库到InsightFace,从极简到高精度的完整方案

✅ 底层原理:深度学习、度量学习、迁移学习三大技术基石

✅ 最新趋势:Transformer、全同态加密、大模型防伪、多模态融合

✅ 面试要点:5道高频题的标准答案

易错提醒:不要将人脸识别等同于“拍张照片比对”——系统真正“识别”的是面部“数字特征”而非完整人脸照片,验证时摄像头的采集范围可能远超屏幕所示区域-4。

本文属于AI人脸智能助手技术系列的第一篇,下一篇将深入讲解活体检测技术的实现原理与对抗攻击方法,敬请期待。